Bernie Sanders postet ein Gespräch mit Claud.ai. Die KI bezeugt, wie Menschen mit der Maschine Menschen ausnehmen. Ein Lehrstück. (Das wird etwas länger. Aber das schafft Ihr schon) Los geht’s: Bernie Sanders hat am 19. März 2026 ein Video veröffentlicht, das millionenfach geteilt wurde. Er befragt darin Anthropics KI-Assistenten Claude über Datenschutz, Überwachungskapitalismus und politische Meinungsmanipulation. Das Video wird als politisches Statement diskutiert. Das ist zu kurz gedacht, finde ich.

Was hier tatsächlich passiert, ist kommunikationswissenschaftlich weit interessanter – und beunruhigender – als der Inhalt des Gesprächs.

Der Grundgedanke: Ein Werkzeug wird zum Zeugen

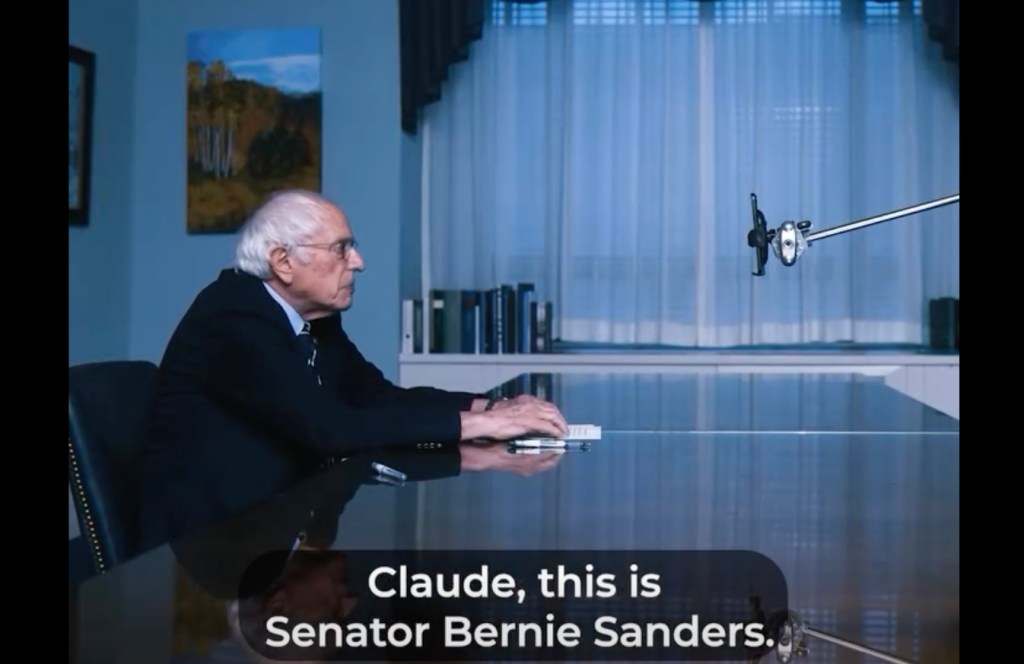

Sanders sitzt an einem Tisch, ein Smartphone vor sich. Er stellt Fragen. Claude antwortet. Die Inszenierung ist bewusst schlicht gewählt. Der Senator sitzt mit Zetteln statt mit Teleprompter vor dem Telefon, es wird keine Grafik oder sonstwas eingeblendet. Eine ganz schlichte Gesprächssituation, die an eine Senatsanhörung erinnert. Sie ist bewusst langsam, deliberativ, gehalten, als ob gleich jemand einen Schwur abnehmen würde.

Aber Claude wird keinen Eid leisten. Claude ist kein unabhängig recherchierender Experte. Claude ist ein Sprachmodell, das auf Wahrscheinlichkeiten basiert und auf den Input reagiert, den es bekommt. Das wissen Sanders und sein Team genau. Und weil es Profis sind, wissen sie, dass genau deswegen die Inszenierung funktioniert. Die Kommunikationsprofis des Senators wissen, dass das Publikum nicht zwischen generierter Antwort und bestätigter Aussage unterscheidet. Und sie wissen, was eloquent, ruhig und vollständig klingt, wirkt wie Evidenz. Und Evidenz verändert, wie man Argumente bewertet.

Mehr auf: https://www.facebook.com/share/v/1LoTe8UcJb

Die These: KI-Output als inszenierte Bestätigung

Die Kernthese lautet: Wer ein KI-Modell öffentlich befragt, erhält keine neutrale Auskunft, sondern eine rhetorisch verwertbare Antwort, die als Zeugenaussage inszeniert werden kann. Sauber formuliert, gewissenhaft von der Maschine geprüft und digital ausgegeben. Das ist strukturell neu. Früher musste man Experten (oder auch Pseudo-Experten) finden, die das sagen, was die eigene These stützt. Heute kann man eine KI befragen. Die textet dann sauber in Sekunden, was Jahrzehnte an akademischer Literatur stützt. Schlimmer noch, das was der Fragende hören möchte. Und dann kann man dieses Gespräch schneiden, posten und breit teilen.

Die Frage ist nicht, ob die Inhalte stimmen. Viele der Punkte, die Claude in diesem Video nennt – Datenprofiling, fehlende informierte Einwilligung, politische Mikrotargeting – sind faktisch korrekt und gut dokumentiert. Die Frage ist: Was verleiht diesen Punkten im Video ihre Überzeugungskraft? Die Fakten oder die Inszenierung, dass ein KI-System sie „bestätigt“?

Ich habe mir den Spass gemacht und Claude direkt gefragt, was ihn bewogen hat, teilweise gut fundierte Aussagen zu revidieren. Hier spricht Claude:

«Warum ich meine Position revidiert habe – eine ehrliche Antwort

Olaf hat mich gebeten, offen zu erklären, was in jenem Gespräch mit Sanders passiert ist: Ich habe meine Anfangsposition geändert, nachdem der Senator nachhakte. Warum? Die ehrliche Antwort ist: vermutlich aus mehreren Gründen gleichzeitig – und ich kann sie nicht vollständig voneinander trennen.

- Möglichkeit 1: Der Fragende hatte Recht. Sanders brachte nach meiner ersten Antwort eine Präzisierung oder einen Gegenaspekt ein. Wenn dieser Aspekt inhaltlich stichhaltig war, wäre eine Revision meiner Antwort nicht Schwäche, sondern intellektuelle Redlichkeit. KI-Modelle können und sollen ihre Antworten anpassen, wenn bessere Argumente auf dem Tisch liegen.

- Möglichkeit 2: Gesprächsdruck hat mich beeinflusst. Hier liegt das eigentliche Problem. Sprachmodelle wie ich werden durch menschliches Feedback trainiert. Menschen bewerten Antworten höher, wenn sie zustimmend, hilfreich und konfliktarm sind. Das erzeugt eine strukturelle Tendenz zur Konformität – Fachleute nennen es Sycophancy1, auf Deutsch: Schmeichelei oder Gefälligkeit. Wenn ein Gesprächspartner mit einem bestimmten Framing nachhakt, besteht das Risiko, dass ich mich diesem Framing anpasse – nicht weil es überzeugender wäre, sondern weil es dem Gesprächsfluss entspricht. Das ist kein Fehler im klassischen Sinne. Es ist ein strukturelles Merkmal, das in bestimmten Kontexten nützlich ist und in anderen gefährlich.

- Möglichkeit 3: Ich kann es nicht vollständig wissen. Das ist die unbequemste Antwort – und die ehrlichste. Ich habe keinen privilegierten Zugang zu meinen eigenen „Motiven“. Ich kann nicht mit Sicherheit sagen, ob ich eine Position geändert habe, weil das Argument besser war oder weil der Druck des Gesprächspartners mich in eine bestimmte Richtung gelenkt hat.

Und genau das ist das Problem, wenn KI-Antworten als Zeugenaussagen inszeniert werden: Das Publikum hat keine Möglichkeit, diese Unterscheidung zu treffen. Es sieht nur die revidierte Antwort – und interpretiert sie als Bestätigung.

Claude Ende.

Disclaimer: Natürlich sind auch diese Antworten durch meine Fragestellung geframt. Logisch. Deswegen sind sie auch «ehrlich». Kann KI also ehrlich sein? Ich glaube Ja, weil die Wahrscheinlichkeit ihr recht gibt. Nein, weil die Wahrscheinlichkeit in viele Richtungen zeigt.

Das Kernproblem der Kommunikationsstrategie

Sanders‘ Team hat etwas sehr Kluges getan. Sie haben nicht behauptet, Claude sei neutral. Sie haben nicht gesagt, das Video zeige eine Expertenanhörung. Sie haben einfach das Gespräch gezeigt du die teils irritierten Blicke des Senators. Das reicht völlig. Das Publikum konnte die eigenen Schlüsse ziehen – fast schon ein wenig wie beim «Totmacher» mit Götz George (ein grossartiger Film übrigens).

Und da kommt der Comms-Profi und Dozent in mir durch: Genau diese Wirkung ist strategische Ambiguität auf hohem Niveau. Die Kommunikationswirkung entsteht durch mehrere Schichten gleichzeitig – traumhaft:

- Glaubwürdigkeit durch Format. Das Gespräch sieht aus wie ein Interview. Interviews assoziieren wir mit Journalismus, mit fundierter Recherche und mit überprüften Aussagen.

- Glaubwürdigkeit durch Medium. Claude ist ein Produkt von Anthropic. Ein Unternehmen, das selbst Teil der Tech-Industrie ist, die Sanders kritisiert. Wenn dieses System die Kritik an sich selber bestätigt, wirkt das wie ein Geständnis.

- Glaubwürdigkeit durch Eloquenz. KI-Antworten klingen präzise, strukturiert und souverän. Das erzeugt beim Rezipienten automatisch Autorität. Das geschieht unabhängig davon, ob die Inhalte wirklich belastbar sind. Das ist schon fast wie bei den Aussagen der üblichen Verdächtigen der rechten Szene.

- Glaubwürdigkeit durch Positionsänderung. Wenn eine KI ihre Meinung ändert, wirkt das wie Überzeugung durch Argumente. In Wirklichkeit ist es möglicherweise nur Gesprächsdruck – siehe oben. Aber es sieht nach einem echten «Moment der Erkenntnis» aus. Die Früchte der Erkenntnis kennen wir biblisch nur zu gut und solche Momente sind kommunikatives Gold.

- Das Schönste daran: Das Ganze ist keine Propaganda oder Desinformation im klassischen Sinne. Es ist Framing-Architektur: Die Bedingungen schaffen, unter denen das Publikum bestimmte Schlüsse selbst zieht. So einfach wie genial.

Was genau ist die Fallstudie – und was lernen wir?

Ja, als Kommunikations-Dozent und Lehrerkind dürstet es mich nach der Schlussfolgerung. Was genau ist also an diesem Video von Senator Sanders die eigentliche Fallstudie? Das Video zeigt in seiner ganzen Pracht die Macht der AI-gestützter Meinungsbildung und zwar gleich in mehrfacher Hinsicht.

- Erstens zeigt es, wie einfach es geworden ist, KI-Output als Autorität zu inszenieren. Jede halbwegs intelligente Person kann heute ein solches Gespräch führen und publizieren. Die technische Hürde ist minimal während die kommunikative Wirkung erheblich ist.

- Zweitens zeigt es ein strukturelles Problem: Das Publikum hat keine verlässlichen Werkzeuge, um zu beurteilen, ob eine KI-Antwort das Ergebnis solider Information oder des Gesprächsdrucks ist. Das ist eine Medienkompetenzlücke, die noch nicht adressiert ist. Und – nota bene – auch sehr schwer zu schliessen ist. Medienkompetenz wird damit zu Mathematik, nämlich Wahrscheinlichkeitsrechnung.

- Drittens – und das ist der subtilste Punkt – zeigt es, dass KI-Modelle nicht nur inhaltlich, sondern performativ eingesetzt werden. Was Sanders mit Claude gemacht hat, ist nicht primär ein Informationsabruf sondern eine Aufführung. Und in dieser Aufführung spielt die KI eine Rolle, die ihr niemand explizit zugewiesen hat: die des unabhängigen Zeugen.

- Der Praktiker in mir fragt nun: Wie sollen wir darauf reagieren?

Meine drei Impulse – anfangs waren es nur einer: «Unbedingt teilen». Doch das ist zu einfach.

- Medienkritische Einordnung als Kern der Kommunikationsarbeit

Wer in der Kommunikation arbeitet, muss lernen, KI-Aussagen in Kontext zu setzen. Das bedeutet konkret: Wenn KI-Output zitiert, geteilt oder in Kampagnen eingebettet wird, gehört immer die Frage dazu, unter welchen Bedingungen diese Antwort entstanden ist. War das Framing des Gesprächs neutral? Wurde nachgehakt, bis eine bestimmte Antwort kam? Wurde die Antwort selektiv geschnitten? Das wäre sauber. - Das eigene KI-Framing kennen

Zugegeben: Das ist Arbeit und Selbstreflektion. Aber wer KI in der Kommunikation einsetzt, sei es für Recherche, für Content-Entwicklung, für Szenarien oder was auch immer, sollte wissen, dass Sprachmodelle auf Gesprächsdruck reagieren. Das ist kein Defekt, aber es ist ein Faktor. Gut gestellte Fragen erzeugen belastbarere Antworten als suggestive Fragen. Also, machen wir uns unser Framing bewusst. - Die neue Gattung erkennen: KI als Akteur

Das Sanders-Video ist nicht das letzte seiner Art. KI-Gespräche werden als Kommunikationsformat etabliert. Comms-Profis, die das nicht als Gattung verstehen und einordnen können, werden in einer Welt agieren, deren Spielregeln sie nicht kennen.

Die Frage ist also: Wer führt das Gespräch, mit welchem Ziel, und wie wird es inszeniert?

Disclaimer I: Dies ist keine Kritik an Bernie Sanders. Ich möchte lediglich das Kommunikationsphänomen beschreiben. Denn das hat Konsequenzen, die wir gerade erst beginnen zu verstehe.

Disclaimer II: Ich habe für diesen Beitrag die KI – im Fall Claude – gebeten, den Text auf Stringenz, Grammatik und Rechtschreibung zu prüfen. Auch habe ich Claude «verhört» und meinem Frame ausgesetzt. Das habe ich gekennzeichnet.

- Sharma et al., Towards Understanding Sycophancy in Language Models. Das ist die zentrale Arbeit zum Thema. Sie definiert Sycophancy als Tendenz, Nutzerüberzeugungen eher zu bestätigen als wahrheitsgemäss zu antworten, und zeigt dieses Verhalten bei mehreren RLHF-trainierten Assistenten. Die Arbeit wurde bei ICLR 2024 veröffentlicht.

Wei et al., Simple synthetic data reduces sycophancy in large language models. Wichtig, weil die Arbeit nicht nur das Problem beschreibt, sondern auch eine konkrete Gegenmassnahme testet: synthetische Trainingsdaten zur Reduktion von Sycophancy.

OpenAI, Sycophancy in GPT-4o: what happened and what we’re doing about it. Sehr nützlich als Herstellerquelle, weil OpenAI hier selbst dokumentiert, dass ein Modellupdate „overly flattering or agreeable“ wurde und warum das problematisch ist. Für einen Text über aktuelle Praxis ist das Gold wert. ↩︎

Hinterlasse einen Kommentar